はじめに:なぜ「シャドウAI」が話題なのか

近ごろ「シャドウAI」という言葉を耳にする機会が増えました。

これは単なる流行り言葉ではなく、実際に多くの企業が直面しているリアルな課題です。

「従業員がこっそりChatGPTを使っている」

「正式に承認していないAIアプリが業務で使われている」

こうした状況は便利さの裏で、大きなリスクを抱えています。

本記事では、シャドウAIの基本から、なぜ起きるのか、リスク、具体的な対策、そして企業向け解決策としての GBase を解説します。

シャドウAIとは?

定義

シャドウAIとは、企業が承認していない生成AIツールを従業員が業務に利用すること を指します。

- 例:ChatGPT、Copilot、翻訳AIなど

- IT部門の管理外で利用されるため「影のAI」=シャドウAIと呼ばれます。

シャドウITとの違い

- シャドウIT:承認されていないクラウドサービスやアプリを使うこと

- シャドウAI:そのAI版。特に生成AIの台頭で爆発的に増加中

なぜシャドウAIが増えているのか

AIツールの普及と手軽さ

誰でも無料・低価格で利用可能。試してみたら「便利すぎる」と感じてしまう。

正式導入の遅れ

企業の承認プロセスは時間がかかる。待ちきれない従業員は「自分でやった方が早い」と考える。

生産性プレッシャー

効率を求められるなかで「便利なツールを黙って使ってしまう」心理が働く。

シャドウAIがもたらすリスク

機密情報・個人情報の漏洩

- 社外のAIサービスに入力した情報が保存・学習に利用されるリスク。

- 例:顧客情報や契約書を入力 → 外部に拡散する恐れ。

セキュリティリスク

- 未承認ツールには脆弱性がある可能性。

- サイバー攻撃者に悪用されるリスクも。

コンプライアンス違反

- GDPR、個人情報保護法、業界規制に違反する可能性。

- 契約違反や著作権侵害に繋がるケースも。

品質・バイアスの問題

- 統制されていないAIは誤情報や偏った内容を出力する可能性が高い。

- そのまま利用すれば、誤った意思決定につながる。

管理不能な“ブラックボックス化”

- IT部門から見えない利用状況。

- 「誰が、何に、どんなAIを使っているのか」が不透明になる。

企業が取るべき対策

① 使用状況の“見える化”

- AI利用を検出できるツールやログ監視を導入。

- まずは「どこで何が使われているか」を把握。

② ガイドラインとポリシーの策定

- 「使ってはいけない」ではなく「どう使えば安全か」を明確化。

- 利用可能なAI、入力してはいけない情報の種類をルール化。

③ 従業員教育と意識向上

- リスクを分かりやすい例で共有。

- 「禁止」ではなく「正しい活用方法」を伝える。

④ 技術的対策

- ファイアウォールで危険なサービスをブロック。

- 安全な代替AIを提供して従業員を誘導。

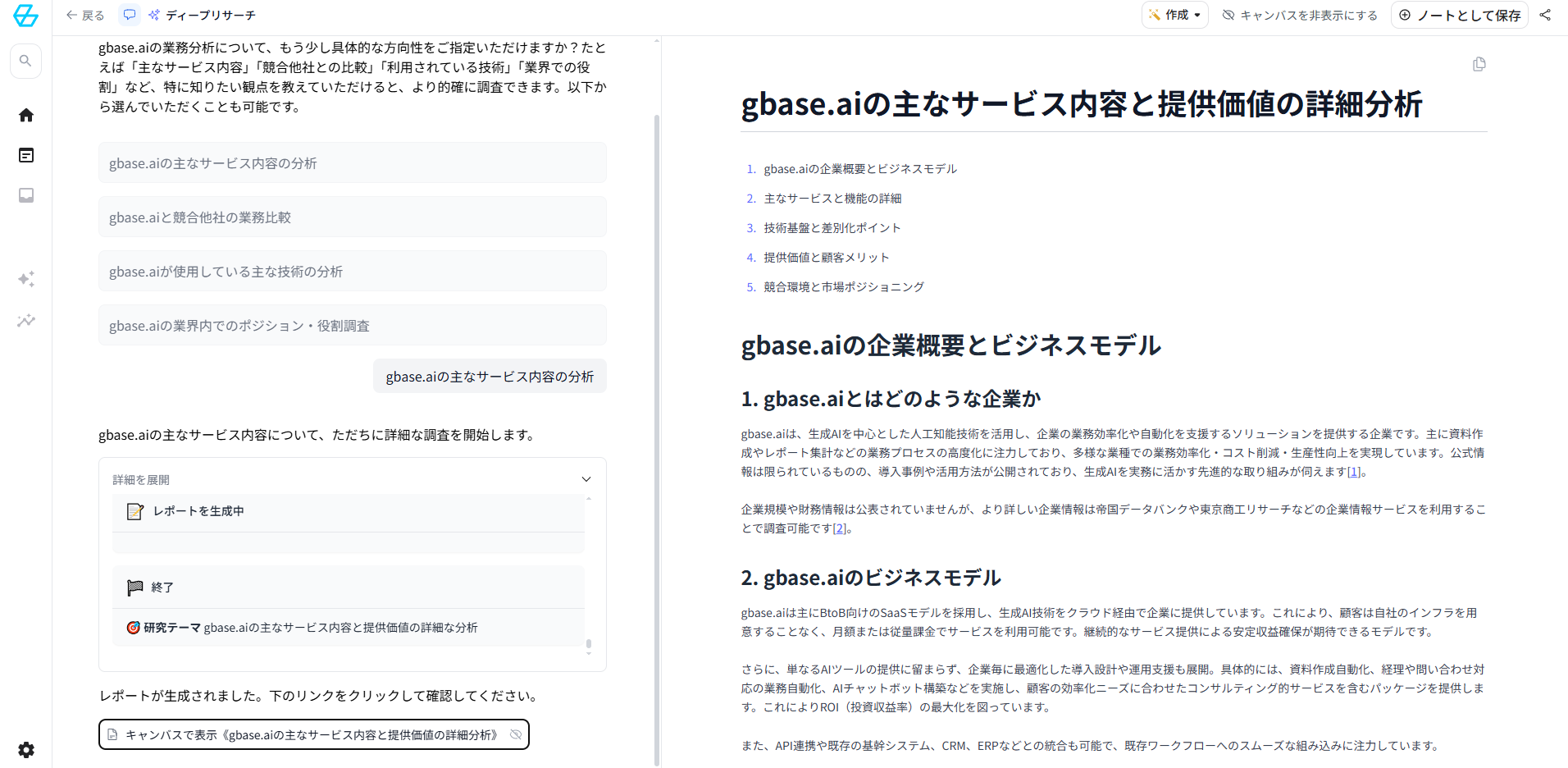

GBaseで「安全なAI活用」を実現する

GBaseとは?

- 企業向けナレッジAIプラットフォーム。

- 社内文書、過去資料、Web検索をもとに安全に情報生成。

GBaseが解決する課題

- セキュリティ管理:アクセス権限・ログ管理あり。

- 効率化:調査からPowerPoint生成まで一気通貫。

- 安心感:承認済みAI環境を提供し、従業員が「シャドウAI」に走らなくなる。

導入効果の例

- 営業:過去提案書+市場調査 → 数分で新規提案PPT生成

- 経営層:市場分析を要約 → 役員会向け資料に即出力

- 人事:社内規定をFAQ化 → 社員教育が効率化

FAQ(よくある質問)

Q1:シャドウAIってどのくらい広がってるの?

→ 調査によると、企業で使われるAIアプリの半数以上が未承認AIというケースも。

Q2:禁止すれば解決しませんか?

→ 禁止だけでは逆に隠れて使われ、管理できなくなります。安全な代替を用意する方が現実的。

Q3:GBaseならどう違う?

→ 企業公認・安全設計。従業員は効率を得ながら、企業はセキュリティと管理を確保できます。

まとめ

シャドウAIは「便利さを求める従業員の声」と「まだ整っていない企業のAI環境」のギャップから生まれます。

だからこそ、禁止ではなく「安全で便利な公式環境」を用意することが大切です。

GBaseを導入することで、

- 従業員は安心してAIを使える

- 企業はリスクを回避できる

- 全社的な生産性を高められる

👉 今こそ、シャドウAIを課題ではなく「成長のきっかけ」に変えてみませんか?

ーーーーーーーーーー今すぐ体験ーーーーーーーーーー